微軟本週發表了一篇研究論文,重點介紹了一種名為VASA-1 的新人工智慧模型,該模型可以將一個人的單一圖片和音訊片段轉換為一個真實的口型同步影片——包括面部表情、頭部動作等。

AI 模型接受了 DALL·E-3 等生成器的 AI 生成影像的訓練,然後研究人員將這些影像與音訊剪輯分層。 結果是圖像變成了說話的臉的影片。

研究人員以 Runway 和 Nvidia 等競爭對手的技術為基礎,但在論文中表示,他們的做事方法質量更高、更現實,並且「顯著優於」現有方法。

相關:Adobe 的 Firefly 影像產生器部分接受了 Midjourney 的 AI 影像的訓練

研究人員表示,該模型可以接收任意長度的音頻,並根據剪輯產生會說話的臉。

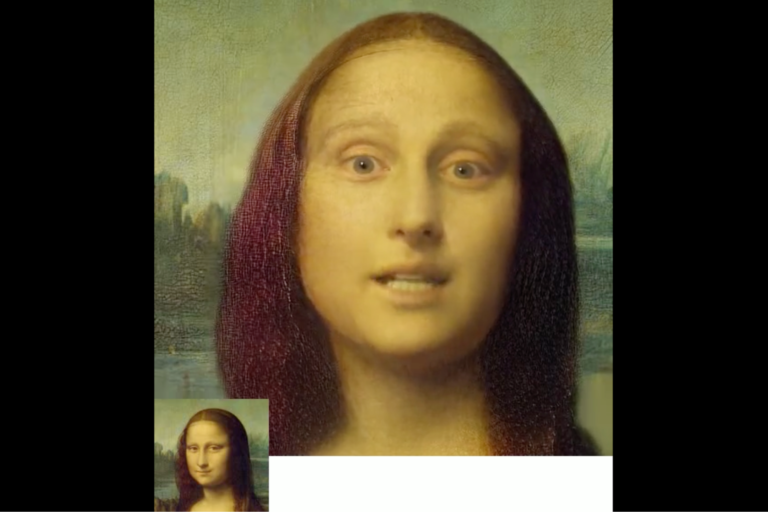

研究人員試驗的唯一一張不是人工智慧生成的圖像是《蒙娜麗莎》。 他們將這張標誌性的圖像與安妮·海瑟薇(Anne Hathaway) 的《狗仔隊》(Paparazzi) 進行了口型同步,該歌曲的開頭是“喲,我是狗仔隊,我不玩快艇” 。 影片中影格的螢幕截圖。 信用:企業家

影片中影格的螢幕截圖。 信用:企業家

《蒙娜麗莎》是人工智慧模型未接受過訓練的照片輸入的一個例子,但無論如何都可以對其進行操作。 該模型還可以轉換藝術照片、接收歌唱音訊以及處理非英語語言的語音。

研究人員強調,該模型可以透過演示影片即時工作,該影片顯示該模型透過頭部運動和臉部表情立即製作動畫圖像。

深度偽造(Deepfakes),即對某人進行數位化修改的媒體,可能會傳播錯誤訊息或未經許可盜用某人的肖像,這是先進人工智慧帶來的風險,它可以產生參考點相對較少的數位媒體。

有關的: 田納西州通過法律保護音樂家免受人工智慧深度假貨的侵害

微軟在論文中普遍解決了這一問題,研究人員表示,“我們反對任何為真人製造誤導性或有害內容的行為,並且有興趣應用我們的技術來推進偽造檢測。”

研究人員表示,他們的技術也具有潛在的正面應用,例如提高可近性和加強教育工作。

谷歌上個月演示了一個類似的研究項目,展示了人工智慧能夠拍照並從中創建視頻,然後用戶可以用語音控制。 人工智慧能夠添加頭部動作、眨眼和手勢。